针对 Kimsufi显卡服务器推荐 Tesla V100搭配512G内存且月付仅799元这一配置,这确实是当前高性能计算市场中极具性价比的优选方案,对于从事深度学习训练、科学计算、3D渲染以及大规模虚拟化应用的专业用户而言,该配置在算力密度与内存容量上达到了完美的平衡,能够有效解决因显存不足或内存溢出导致的训练中断问题,同时其低廉的月付成本极大地降低了项目初期的硬件投入门槛和试错风险。

Tesla V100核心架构与算力优势

Tesla V100作为NVIDIA Volta架构的旗舰级计算卡,并非简单的消费级显卡升级,而是专为数据中心和人工智能计算设计的加速器,该显卡最核心的优势在于其集成了640个Tensor Cores,这是专门为加速深度学习矩阵运算而设计的硬件单元,在混合精度计算(FP16)场景下,V100能够提供高达125 TFlops的深度学习算力,这一数值是前代P100卡片的数倍,对于需要训练复杂神经网络模型(如BERT、ResNet-152)这意味着训练周期可以从数周缩短至数天。

V100配备了32GB或16GB的高速HBM2显存,显存带宽突破了900GB/s,在处理高分辨率图像处理、视频分析或大规模自然语言处理任务时,超大带宽确保了GPU核心不会因为数据传输瓶颈而空转,与市面上同价位的RTX 3090或4090相比,虽然单精度浮点性能(FP32)在某些消费级显卡上看似接近,但V100在ECC纠错内存支持、多实例GPU(MIG)功能以及长期7×24小时高负载运行的稳定性上,具有消费级显卡无法比拟的优势,这对于需要连续运行数周训练任务且不能容忍任何内存翻转错误的科研或商业项目至关重要。

512G大内存的独特价值

在推荐配置中,512G内存是一个往往被低估但极其关键的参数,在深度学习预处理阶段,庞大的数据集通常需要加载到内存中进行快速清洗、增强和分批处理,如果内存不足,系统将不得不频繁使用交换空间,导致I/O性能急剧下降,GPU利用率会从90%跌至个位数,拥有512G内存意味着用户可以将整个ImageNet或COCO等大型数据集完全驻留在内存中,实现真正的“零延迟”数据馈送。

对于虚拟化应用而言,512G内存允许在同一台物理服务器上通过Docker或KVM运行多个高负载实例,用户可以同时分配给三个不同的开发团队每人128G内存和独立的GPU分区,互不干扰地进行开发测试,这种资源隔离能力使得该服务器不仅适合单人使用,也适合作为小团队的核心计算节点,在科学计算领域,如分子动力学模拟或气象建模,512G内存支持了更大规模的网格计算,使得在单机内存中求解更复杂的方程组成为可能,从而避免了昂贵的集群互联开销。

月付799元的价格竞争力分析

将Tesla V100与512G内存组合并以799元每月的价格提供,这在全球云服务及独立服务器市场中都属于“价格破坏者”级别的产品,通常情况下,配备同等规格V100的云服务器(如AWS或Google Cloud)按需付费价格往往在每小时10元至15元人民币以上,月付成本轻松超过7000元,即便是预留实例或长期租约,也很难将价格压低至千元以内。

Kimsufi之所以能提供如此低价,主要得益于其独特的商业模式,作为OVH集团旗下的子品牌,Kimsufi专门销售经过重新测试和翻新的企业级退役设备或库存尾货,这些硬件虽然并非全新,但经过了严格的数据擦除和压力测试,其电气性能和稳定性依然符合工业级标准,对于预算敏感的初创企业、独立研究员或学生群体,这提供了一个接触企业级高性能计算的唯一途径,799元的月费甚至低于高端游戏显卡的折旧成本,使得“算力租赁”优于“硬件购买”成为显而易见的选择。

专业应用场景与解决方案

基于上述硬件配置,该服务器非常适合作为深度学习训练的主节点,在PyTorch或TensorFlow框架下,用户可以利用V100的Tensor Core加速混合精度训练,建议在配置环境时,安装CUDA 10.2或更高版本以及对应的cuDNN库,并开启NCCL通信库以优化多GPU并行效率(如果服务器配置多卡),对于512G内存的利用,建议调整DataLoader的num_workers参数,利用多核CPU将数据预加载至内存,构建高效的数据管道。

在3D渲染领域,利用V100的大显存,可以渲染包含数亿多边形的复杂场景,而无需担心显存溢出,配合512G内存,可以同时加载高分辨率纹理贴图和复杂的物理模拟缓存,对于虚拟化解决方案,推荐使用Proxmox VE或VMware ESXi作为底层系统,利用PCI Passthrough技术将显卡直通给虚拟机,从而在获得接近原生性能的同时,保证了租户间的完全隔离。

部署与运维注意事项

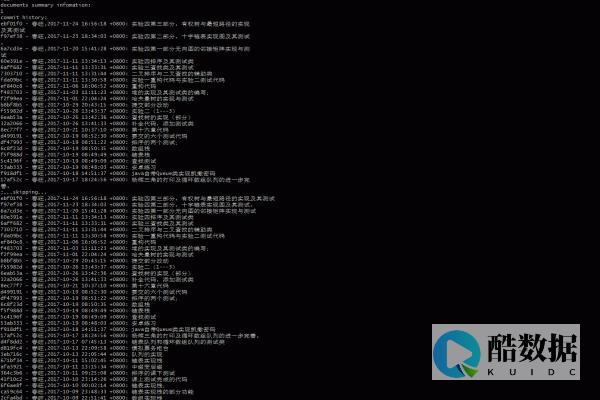

虽然Kimsufi提供了极具吸引力的硬件,但其服务模式通常属于“自助式”,这意味着用户需要具备一定的linux系统运维能力,在收到服务器后,首要任务是检查GPU状态,使用

nvidia-smi

命令确认驱动版本、显存大小以及功耗墙设置,由于V100功耗较高(通常为250W或300W),建议在运行高负载任务前监控服务器温度曲线,确保散热系统工作正常。

关于系统选择,推荐使用Ubuntu 20.04 LTS或22.04 LTS,这些发行版对CUDA和主流AI框架有最好的兼容性,考虑到Kimsufi不提供像AWS那样的深度学习AMI镜像,用户需要自行配置Conda环境或使用Docker容器来部署运行环境,为了防止数据丢失,务必配置定时备份任务,将模型Checkpoints和重要数据同步至对象存储(如AWS S3兼容服务)或异地服务器,因为独立服务器通常不包含本地快照备份服务。

购买建议与互动性小编总结

Kimsufi提供的Tesla V100搭配512G内存、月付799元的服务器配置,是目前市场上性价比极高的深度学习和高性能计算解决方案,它以极低的成本提供了企业级的计算能力和大容量内存,特别适合需要长时间运行训练任务、处理大规模数据集或进行复杂科学计算的用户,虽然需要用户具备一定的运维能力,但其节省下来的硬件成本足以覆盖这部分时间投入。

您是否正在寻找能够运行大模型训练的高性价比服务器?或者您在配置深度学习环境时遇到过哪些棘手的问题?欢迎在评论区分享您的需求或经验,我们可以一起探讨如何利用这台服务器最大化您的计算效率。

![揭秘其配置流程与技巧疑问-iss配置网站如何高效使用 (配置流策略,no_ai_sug:false}],slid:130284672013430,queryid:0x15767e43985476)](https://www.kuidc.com/zdmsl_image/article/20260206200044_98877.jpg)

发表评论