服务器管理的核心在于通过软硬件协同机制,实现对计算资源的精细化调度、状态监控与安全保障,从而确保业务系统的高可用性、数据一致性以及服务响应速度,其本质是 将底层的物理硬件资源通过虚拟化技术抽象化,再由操作系统层进行资源分配,最终通过网络协议对外提供服务 的全过程闭环控制,这一过程不仅要求对CPU、内存、I/O等硬件指标有敏锐的感知,更需要通过自动化脚本与安全策略,构建起一套具备自我修复与防御能力的智能运维体系。

硬件资源与虚拟化抽象原理

服务器管理的物理基础是对硬件资源的精确掌控,在底层,管理原理涉及对CPU指令集调度、内存寻址以及磁盘I/O吞吐的实时监控,现代服务器管理早已超越了单纯的硬件维护,而是深度依赖 虚拟化技术 ,通过Hypervisor(虚拟机监视器),物理服务器被切分为多个独立的逻辑实例,每个实例都拥有独立的操作系统和资源配额。

这种 硬件虚拟化 原理允许管理员在不关机的情况下,动态调整计算资源的分配,当检测到某个Web应用的内存占用率持续超过阈值时,管理后台会触发动态内存热添加(Ballooning)或内存页交换机制。 资源隔离 是这一层面的关键,通过cgroUPS(控制组)等内核技术,确保某个失控的进程不会耗尽整台服务器的资源,从而保障同一物理机上其他业务实例的稳定运行。

操作系统层进程与服务控制

在操作系统层面,服务器管理的核心任务是 进程生命周期管理 与 系统调优 ,操作系统内核充当了硬件与用户程序之间的翻译官,服务器管理原理要求管理员深入理解内核空间与用户空间的交互,当一项服务启动时,系统需要加载依赖库、分配堆栈空间,并监听特定的网络端口。

守护进程(Daemon) 的管理是维持服务在线的关键,专业的服务器管理通常采用Systemd或Supervisor等工具来监控服务状态,一旦主进程崩溃,管理机制会立即尝试重启服务,实现秒级故障恢复。 文件系统管理 也不容忽视,对于高并发写入场景,管理原理会建议采用nosql或调整文件系统挂载参数(如noatime)以减少磁盘写入频率,延长硬件寿命并提升IOPS。

网络通信与流量调度机制

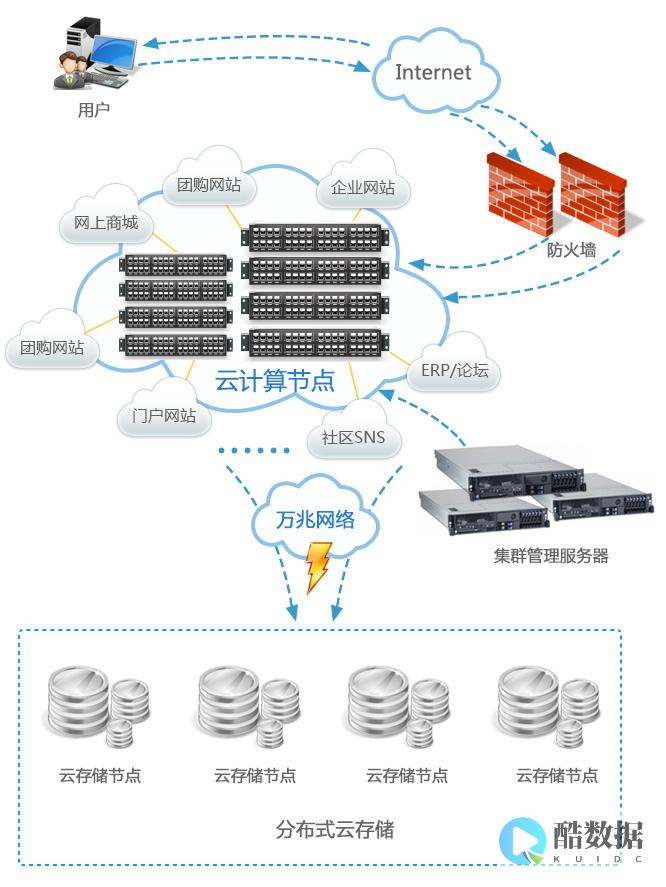

服务器对外服务的能力完全依赖于网络协议栈的高效运转,网络管理的原理基于 TCP/IP协议模型 ,重点在于端口监听、连接状态维护以及流量过滤,当外部请求到达时,防火墙(如iptables或netfilter)会根据预设规则链进行匹配,决定数据包是转发、丢弃还是接受。

在多服务器集群环境下, 负载均衡 成为管理的核心组件,其工作原理是将进入的流量根据算法(如轮询、最少连接或源地址哈希)分发到后端不同的服务器节点上,这不仅分散了单点压力,还实现了 高可用性(HA) ,一旦主节点心跳检测失败,虚拟IP(VIP)会自动漂移到备用节点,确保用户无感知切换,专业的管理还会对TCP参数进行深度调优,如调整TCP窗口大小和Keepalive保活时间,以适应高并发或长连接的业务场景。

酷番云 智能运维实战案例

在实际的企业级应用中,单纯依靠人工巡检已无法满足复杂的业务需求,以 酷番云 服务的某电商平台客户为例,该客户在“双十一”大促期间面临瞬时流量激增的挑战,传统的服务器管理往往依赖管理员手动扩容,响应滞后且容易出错。

基于对服务器管理原理的深度理解,

酷番云

为该客户部署了

弹性伸缩与自动化运维解决方案

,我们在底层部署了自定义的监控Agent,实时采集CPU负载与连接数指标,当系统检测到Web服务器并发连接数超过预设的5000阈值时,

酷番云的自动化编排引擎

会立即触发API调用,在30秒内自动拉起多台预配置好的云服务器实例,并自动注入到负载均衡池中。

弹性伸缩与自动化运维解决方案

,我们在底层部署了自定义的监控Agent,实时采集CPU负载与连接数指标,当系统检测到Web服务器并发连接数超过预设的5000阈值时,

酷番云的自动化编排引擎

会立即触发API调用,在30秒内自动拉起多台预配置好的云服务器实例,并自动注入到负载均衡池中。

这一过程完全遵循 自动化闭环控制原理 :监测-分析-执行-反馈,大促结束后,系统根据流量回落趋势自动释放多余资源,帮助客户节省了约40%的算力成本,针对安全层面, 酷番云 利用虚拟化层面的安全组隔离技术,实现了不同租户之间的南北向流量严格管控,有效防御了SQL注入与DDoS攻击,保障了数据的绝对安全。

安全防护与数据持久化策略

服务器管理的最后一道防线是 安全合规 与 数据备份 ,安全管理的核心在于“最小权限原则”,通过SSH密钥认证替代密码登录,并配置sudoers文件限制普通用户的提权操作,是防止服务器被沦陷的基础。 入侵检测系统(IDS) 会通过分析系统日志与网络流量,识别出异常的访问模式。

数据管理方面, RAID磁盘阵列 技术通过条带化、镜像或奇偶校验,在硬件层面提供了数据冗余,而在逻辑层面, 快照与增量备份 则是不可或缺的原理,专业的管理策略会制定“3-2-1”备份规则:即3份数据副本,存储在2种不同介质上,其中1份异地保存,当发生逻辑错误(如误删数据库)时,管理员可以利用秒级快照技术将系统回滚至故障前的状态,最大程度减少业务损失。

相关问答

Q1:云服务器管理和传统物理服务器管理在原理上有什么本质区别? 本质区别在于资源的弹性与交付模式,传统物理服务器管理侧重于对硬件实机的维护(如更换硬盘、布线)和固定资源的静态分配,扩容周期长,而云服务器管理基于 虚拟化与资源池化原理 ,硬件被抽象为庞大的资源池,管理操作通过API调用实现,云管理更强调自动化编排、弹性伸缩和按需计费,能够以秒级速度交付资源,且底层硬件故障对用户透明,由平台自动处理迁移。

Q2:如何判断服务器是否需要扩容或优化? 这需要建立基于 性能基线 的监控体系,管理员应长期关注CPU使用率(持续超过80%)、内存剩余空间(低于10%)、磁盘I/O等待时间和网络带宽利用率等核心指标,如果发现系统Load Average值长期高于CPU核心数,或者磁盘队列长度持续堆积,说明当前资源已成为瓶颈,应优先考虑优化应用代码或数据库查询(垂直优化),若优化后仍无法满足,则需根据服务器管理原理进行水平扩容(增加节点)或垂直扩容(升级配置)。

如果您对服务器管理的高阶技巧或具体的云产品解决方案有更多疑问,欢迎在下方留言讨论,我们将为您提供更具针对性的技术建议。

发表评论