批量替换数据库中字符串

批量替换数据库中字符串是指通过数据库操作,同时更新多个记录的特定字段值,将字段内存在的目标字符串替换为新的字符串,这一操作在数据维护、格式统一、错误修正等场景中具有关键价值:它能显著提升数据更新效率,避免逐条手动修改的繁琐;能保证数据格式的一致性,为后续分析、报表生成等提供稳定的数据基础;还能优化数据查询性能,通过标准化字段内容减少模糊匹配或错误匹配的概率。

通用操作流程

批量替换需遵循“准备→执行→验证”的逻辑,确保操作准确性与安全性。

准备阶段

执行步骤

验证与回滚

不同数据库系统的具体实现

不同数据库的SQL语法略有差异,以下通过表格展示常见数据库的批量替换示例:

| 数据库类型 | SQL语句示例 | 关键点说明 |

|---|---|---|

UPDATE table_name Set column_name = REPLACE(column_name, 'old_str', 'new_str') WHERE column_name LIKE '%old_str%';

|

使用函数实现字符串替换,条件用于筛选包含目标字符串的记录 | |

| PostgreSQL |

UPDATE table SET column = REPLACE(column, 'old', 'new') WHERE column LIKE '%old%';

|

PostgreSQL的函数与MySQL类似,需注意字段名区分大小写(若表名或字段名含大小写,需调整) |

UPDATE table SET column = REPLACE(column, 'old', 'new') WHERE column LIKE '%old%';

|

SQL Server的函数语法与MySQL类似,注意条件需符合SQL Server的语法规则(如使用作为通配符) | |

UPDATE table SET column = REPLACE(column, 'old', 'new') WHERE column LIKE '%old%';

|

Oracle的函数语法与上述类似,但Oracle中作为通配符需配合其他条件,可使用

LIKE '%old%'

|

关键注意事项

常见问题与解答(FAQs)

问题1

:如何处理包含多个空格或特殊字符的复杂字符串替换?

解答

:对于复杂替换场景,可结合正则表达式或分步替换策略,在MySQL中,使用

REGEXP_REPLACE(column_name, 'pattern', 'replacement')

实现更复杂的模式匹配(如替换所有连续空格为单个空格);在SQL Server中,可使用函数结合、等函数逐步替换特殊字符;在PostgreSQL中,使用

regexp_replace(column, 'pattern', 'replacement', 'g')

(表示全局替换),可先对字段内容进行预处理(如去除多余空格),再执行替换操作。

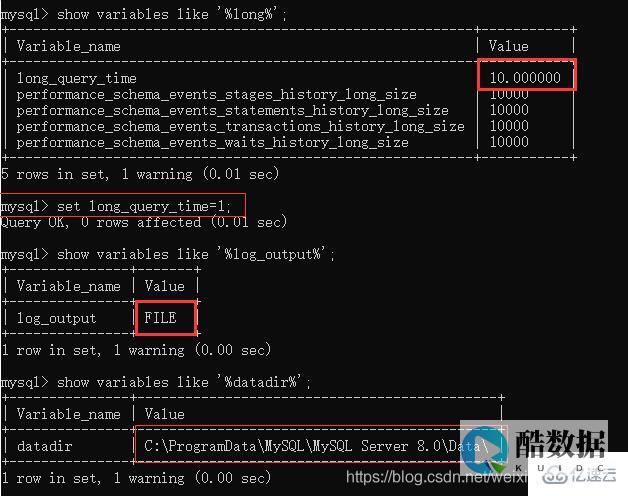

问题2 :批量替换时如何避免性能问题? 解答 :1. 分批处理:对于大型表,将更新操作分批次执行(如每次更新1000行),减少单次操作对数据库资源的影响,2. 事务管理:使用事务控制,减少日志写入(如批量更新时,事务日志会记录所有变更,分批处理可降低日志量),3. 索引优化:若替换操作不影响索引结构,可先删除相关索引,更新后再重建;若替换后字段内容变化较大,需重新评估索引必要性,4. 测试性能:在测试环境中模拟生产数据量,测试不同批次的更新速度,根据结果调整批次大小。

如何用SQL批量修改表里一列的值

update creature_loot_templateset ChanceOrQuestChance=100;commit;出现对话框后输入sql,然后找到有个执行的按钮,点下就行。(鼠标放在按钮上停顿一小会,看看按钮的功能,一般是一个向右的三角形)

SQL中。如何批量修改表中的某一项数据的一部分?

最好的方法是批量修改,即每次修改5000条(一次修改不要超过一万条,否则影响性能). 虽然在11g中,我们也可以选择使用merge命令,但你的这种情况最好先修改一部分然后看看影响,毕竟在生产环境作这样的操作风险很大。 如果是误操作,最好还是请DBA来恢复,虽然这样做会被挨骂,但总比错上加错,最后连挨骂的机会都没有要好得多。 如果对这些修改真的有信心,而只是从性能考虑,那可以用下面的方法(pk_col 是表的主键):merge into xxx aausing (select pk_col from xxx) bbon (_col=_col)when matched thenupdate set =66 where is null;

ORACLE 常用操作语句规范和注意事项

规范: i. 尽量避免大事务操作,慎用holdlock子句,提高系统并发能力。 ii. 尽量避免反复访问同一张或几张表,尤其是数据量较大的表,可以考虑先根据条件提取数据到临时表中,然后再做连接。 iii. 尽量避免使用游标,因为游标的效率较差,如果游标操作的数据超过1万行,那么就应该改写;如果使用了游标,就要尽量避免在游标循环中再进行表连接的操作。 iv. 注意where字句写法,必须考虑语句顺序,应该根据索引顺序、范围大小来确定条件子句的前后顺序,尽可能的让字段顺序与索引顺序相一致,范围从大到小。 v. 不要在where子句中的“=”左边进行函数、算术运算或其他表达式运算,否则系统将可能无法正确使用索引。 vi. 尽量使用exists代替select count(1)来判断是否存在记录,count函数只有在统计表中所有行数时使用,而且count(1)比count(*)更有效率。 vii. 尽量使用“>=”,不要使用“>”。 viii. 注意一些or子句和union子句之间的替换 ix. 注意表之间连接的数据类型,避免不同类型数据之间的连接。 x. 注意存储过程中参数和数据类型的关系。 xi. 注意insert、update操作的数据量,防止与其他应用冲突。 如果数据量超过200个数据页面(400k),那么系统将会进行锁升级,页级锁会升级成表级锁。 b) 索引的使用规范: i. 索引的创建要与应用结合考虑,建议大的OLTP表不要超过6个索引。 ii. 尽可能的使用索引字段作为查询条件,尤其是聚簇索引,必要时可以通过index index_name来强制指定索引 iii. 避免对大表查询时进行table scan,必要时考虑新建索引。 iv. 在使用索引字段作为条件时,如果该索引是联合索引,那么必须使用到该索引中的第一个字段作为条件时才能保证系统使用该索引,否则该索引将不会被使用。 v. 要注意索引的维护,周期性重建索引,重新编译存储过程。 c) tempdb的使用规范: i. 尽量避免使用distinct、order by、group by、having、join、cumpute,因为这些语句会加重tempdb的负担。 ii. 避免频繁创建和删除临时表,减少系统表资源的消耗。 iii. 在新建临时表时,如果一次性插入数据量很大,那么可以使用select into代替create table,避免log,提高速度;如果数据量不大,为了缓和系统表的资源,建议先create table,然后insert。 iv. 如果临时表的数据量较大,需要建立索引,那么应该将创建临时表和建立索引的过程放在单独一个子存储过程中,这样才能保证系统能够很好的使用到该临时表的索引。 v. 如果使用到了临时表,在存储过程的最后务必将所有的临时表显式删除,先Truncate table,然后drop table,这样可以避免系统表的较长时间锁定。 vi. 慎用大的临时表与其他大表的连接查询和修改,减低系统表负担,因为这种操作会在一条语句中多次使用tempdb的系统表。 d) 合理的算法使用: 根据上面已提到的SQL优化技术和ASE Tuning手册中的SQL优化内容,结合实际应用,采用多种算法进行比较,以获得消耗资源最少、效率最高的方法。 具体可用ASE调优命令:set statistics io on, set statistics time on , set showplan on 等。

发表评论