随着使用习惯的变化,网络应用访问强度也越来越大,对负载均衡技术的需求也不断增加。而 SLB ,也就是 服务器 负载均衡,是常用的网络应用部署方式,能够实现对客户端流量的多服务器负载均衡。而今天要讨论的,是 SLB 融合 Redis 集群的实现进阶。

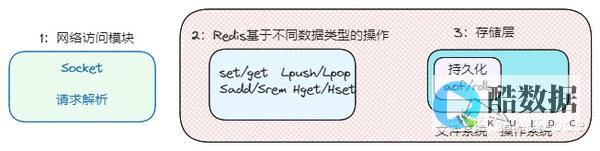

我们先来看看 SLB 如何融合 Redis 集群,要实现这一点,其基础原理是,第一步 SLB 负载均衡算法的选择,第二步是 SLB 负载均衡器将客户端的请求转发到 Redis 集群中匹配的实例,第三步连接 Redis 集群的实例,最后的步骤便是读写 Redis 集群的相关数据。

将 SLB 与 Redis 合二为一使用,还有一些SLB功能可以继续优化实现,这里我们提供三种常用的 SLB 优化实践方法:

(1)建立Redis集群

为了实现SLB融合Redis集群,首先要创建一个Redis集群,Redis集群是一种将多台Redis服务器组织成一个逻辑数据库,为了保证数据分布相对均衡,Redis集群通常会预先分片,具体来说,在使用 Redis 集群时,就要按照一定的划分原则,将 key 按规则映射到不同的 Redis 服务器上,这个过程称为分片。

例如,可以使用下面的代码创建4个节点的 Redis 集群:

$redisCluster = new RedisCluster($hosts, $ports, true);

(2)SLB支持多种负载均衡算法

SLB 支持多种负载均衡算法来确定是否将请求转发到Redis集群,常用的算法有轮询调度、最小连接数、加权轮询、故障健康检查等。

比如,使用下面的代码实现加权轮询算法负载均衡:

$weightedRoundRobin = new WeightedRoundRobin();$weightedRoundRobin->add('server1', 2);$weightedRoundRobin->add('server2', 1);$weightedRoundRobin->add('server3', 3);$server = $weightedRoundRobin->get();echo "The server selected is: ". $server;

(3)使用Health Check保证Redis集群的稳定性

在 SLB 融合 Redis 集群这一过程中,建议使用 health check 功能,来帮助管理及维护 Redis 集群。 health check 功能可以定时对 Redis 集群中的每一个服务器做特定的检查,以便发现 Redis 集群中的故障服务器,将 unhealthy 状态的 Redis 服务实例从负载均衡池中移除,从而有效提高系统的稳定性和可靠性。

例如,在 Nginx 上使用下面的配置文件实现Health Check:

http {upstream redis_cluster {server redis1.example.com weight=1;server redis2.example.com weight=1;server redis3.example.com weight=1;server redis4.example.com weight=1;check interval=10000 rise=2 fall=2 timeout=1000 type=http;}}

以上就是 SLB 融合 Redis 集群的实现进阶介绍,他能够在保证系统稳定性的前提下,提升系统负载均衡能力及提升集群部署效率,是企业云计算开发的有用Tips。

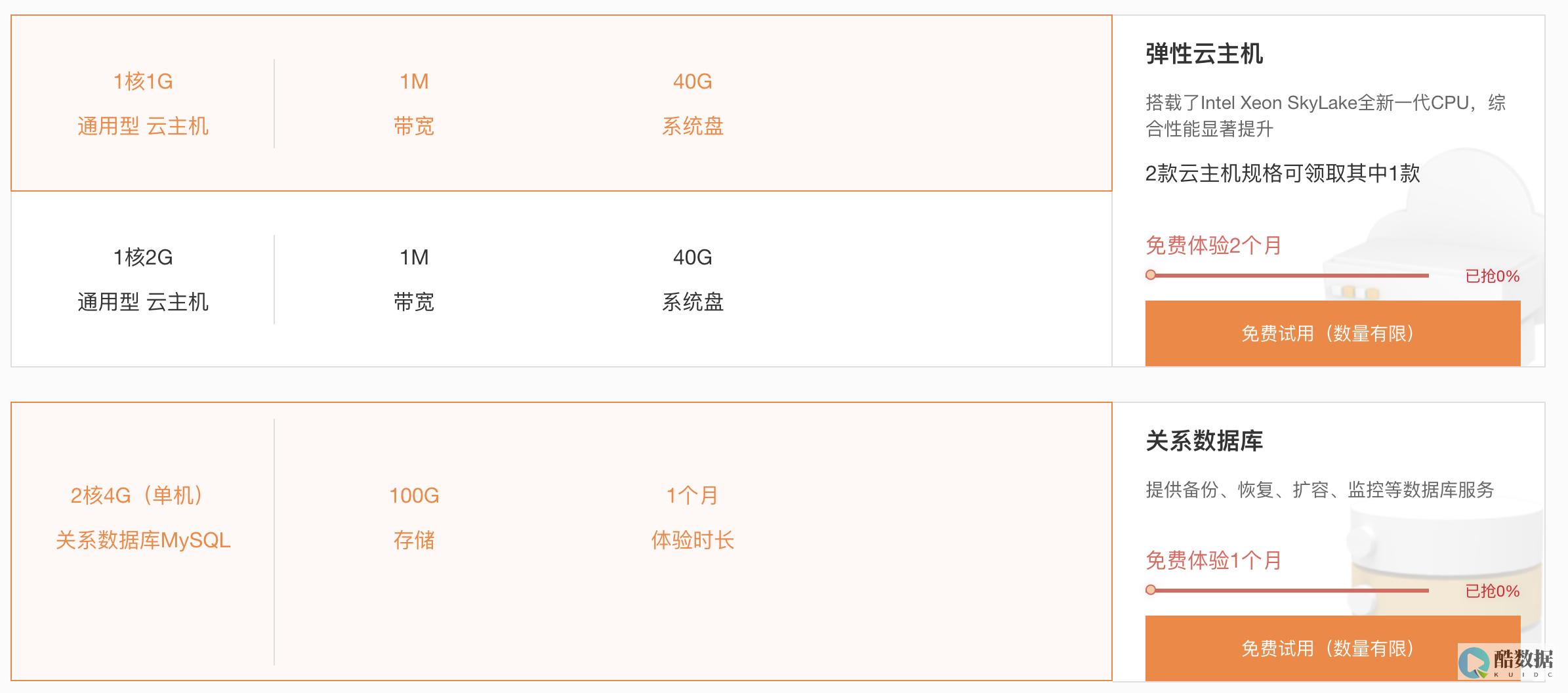

香港服务器首选树叶云,2H2G首月10元开通。树叶云(www.IDC.Net)提供简单好用,价格厚道的香港/美国云服务器和独立服务器。IDC+ISP+ICP资质。ARIN和APNIC会员。成熟技术团队15年行业经验。

redis可以存储WebSocket session对象吗

集群web系统的话,可以通过第三方缓存来统一实现session管理。 如果使用spring的话,可以通过session listener来监听session的变化,实现起来比较方便。 不建议把Session存储起来可以考虑用Redis模拟session,特别是分布式环境,比如多台web serve(如tomcat)r的情况下

目前spring-data-redis到底支不支持redis集群的

spring-data-redis 中的核心操作类是 RedisTemplate 可以看出 key 和 value 都是泛型的,这就涉及到将类型进行序列化的问题了 所就在 RedisTemplate 中还有几个 RedisSerializer~ 1)redisConnectionFactory()配置了如何连接Redsi服务器

memcached和redis的区别

medis与Memcached的区别传统MySQL+ Memcached架构遇到的问题 实际MySQL是适合进行海量数据存储的,通过Memcached将热点数据加载到cache,加速访问,很多公司都曾经使用过这样的架构,但随着业务数据量的不断增加,和访问量的持续增长,我们遇到了很多问题: 需要不断进行拆库拆表,Memcached也需不断跟着扩容,扩容和维护工作占据大量开发时间。 与mysql数据库数据一致性问题。 数据命中率低或down机,大量访问直接穿透到DB,MySQL无法支撑。 4.跨机房cache同步问题。 众多NoSQL百花齐放,如何选择 最近几年,业界不断涌现出很多各种各样的NoSQL产品,那么如何才能正确地使用好这些产品,最大化地发挥其长处,是我们需要深入研究和思考的问题,实际归根结底最重要的是了解这些产品的定位,并且了解到每款产品的tradeoffs,在实际应用中做到扬长避短,总体上这些NoSQL主要用于解决以下几种问题 1.少量数据存储,高速读写访问。 此类产品通过数据全部in-momery 的方式来保证高速访问,同时提供数据落地的功能,实际这正是Redis最主要的适用场景。 2.海量数据存储,分布式系统支持,数据一致性保证,方便的集群节点添加/删除。 3.这方面最具代表性的是dynamo和bigtable 2篇论文所阐述的思路。 前者是一个完全无中心的设计,节点之间通过gossip方式传递集群信息,数据保证最终一致性,后者是一个中心化的方案设计,通过类似一个分布式锁服务来保证强一致性,数据写入先写内存和redo log,然后定期compat归并到磁盘上,将随机写优化为顺序写,提高写入性能。 free,auto-sharding等。 比如目前常见的一些文档数据库都是支持schema-free的,直接存储json格式数据,并且支持auto-sharding等功能,比如mongodb。 面对这些不同类型的NoSQL产品,我们需要根据我们的业务场景选择最合适的产品。 Redis适用场景,如何正确的使用 前面已经分析过,Redis最适合所有数据in-momory的场景,虽然Redis也提供持久化功能,但实际更多的是一个disk-backed的功能,跟传统意义上的持久化有比较大的差别,那么可能大家就会有疑问,似乎Redis更像一个加强版的Memcached,那么何时使用Memcached,何时使用Redis呢?如果简单地比较Redis与Memcached的区别,大多数都会得到以下观点: 1Redis不仅仅支持简单的k/v类型的数据,同时还提供list,set,zset,hash等数据结构的存储。 2Redis支持数据的备份,即master-slave模式的数据备份。 3Redis支持数据的持久化,可以将内存中的数据保持在磁盘中,重启的时候可以再次加载进行使用。 抛开这些,可以深入到Redis内部构造去观察更加本质的区别,理解Redis的设计。 在Redis中,并不是所有的数据都一直存储在内存中的。 这是和Memcached相比一个最大的区别。 Redis只会缓存所有的 key的信息,如果Redis发现内存的使用量超过了某一个阀值,将触发Swap的操作,Redis根据“swappability = age*log(size_in_memory)”计 算出哪些key对应的value需要swap到磁盘。 然后再将这些key对应的value持久化到磁盘中,同时在内存中清除。 这种特性使得Redis可以 保持超过其机器本身内存大小的数据。 当然,机器本身的内存必须要能够保持所有的key,毕竟这些数据是不会进行swap操作的。 同时由于Redis将内存 中的数据swap到磁盘中的时候,提供服务的主线程和进行swap操作的子线程会共享这部分内存,所以如果更新需要swap的数据,Redis将阻塞这个 操作,直到子线程完成swap操作后才可以进行修改。 使用Redis特有内存模型前后的情况对比: VM off: 300k keys, 4096 bytes values: 1.3G used VM on:300k keys, 4096 bytes values: 73M used VM off: 1 million keys, 256 bytes values: 430.12M used VM on:1 million keys, 256 bytes values: 160.09M used VM on:1 million keys, values as large as you want, still: 160.09M used当 从Redis中读取数据的时候,如果读取的key对应的value不在内存中,那么Redis就需要从swap文件中加载相应数据,然后再返回给请求方。 这里就存在一个I/O线程池的问题。 在默认的情况下,Redis会出现阻塞,即完成所有的swap文件加载后才会相应。 这种策略在客户端的数量较小,进行 批量操作的时候比较合适。 但是如果将Redis应用在一个大型的网站应用程序中,这显然是无法满足大并发的情况的。 所以Redis运行我们设置I/O线程 池的大小,对需要从swap文件中加载相应数据的读取请求进行并发操作,减少阻塞的时间。 如果希望在海量数据的环境中使用好Redis,我相信理解Redis的内存设计和阻塞的情况是不可缺少的。

发表评论